Tech

Ironi di Balik Kecanggihan Microsoft Copilot: Hanya untuk Hiburan?

Semarang (usmnews) – Dikutip dari tekno.kompas.com Dunia teknologi baru-baru ini dikejutkan oleh sebuah temuan pada dokumen hukum milik Microsoft. Di tengah promosi besar-besaran mengenai kecerdasan buatan (AI) sebagai masa depan produktivitas, Microsoft justru menyisipkan klausul yang menyatakan bahwa layanan Copilot AI mereka sebenarnya hanya ditujukan untuk tujuan hiburan semata. Ketentuan penggunaan (terms of use) ini memperingatkan pengguna agar tidak mengandalkan teknologi tersebut untuk hal-hal yang bersifat krusial atau penting.

Kontradiksi Antara Pemasaran dan Ketentuan Hukum

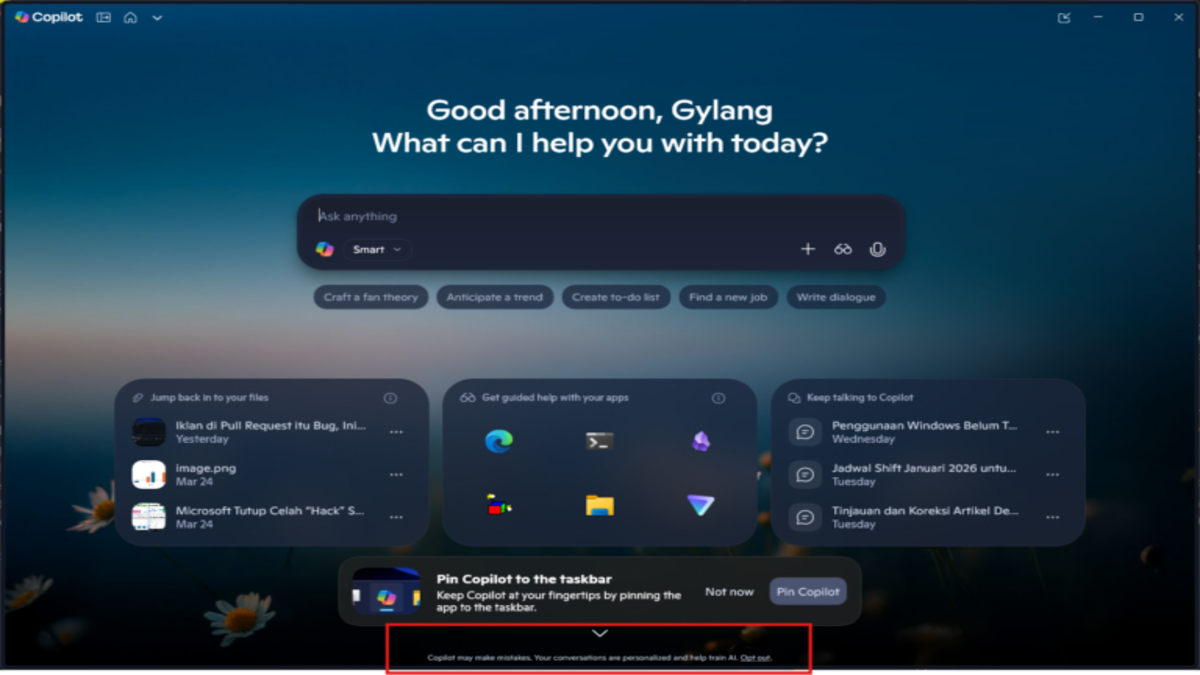

Kebijakan ini memicu gelombang tanda tanya besar di kalangan pengguna dan pengamat teknologi. Pasalnya, selama setahun terakhir, Microsoft sangat gencar mengintegrasikan Copilot ke dalam ekosistem mereka, mulai dari sistem operasi Windows 11 hingga paket produktivitas Microsoft 365. Mereka bahkan melabeli Copilot sebagai “asisten AI” yang mampu meningkatkan efisiensi kerja, membantu penulisan kode pemrograman, hingga menyusun dokumen bisnis yang kompleks.

Namun, dalam dokumen resminya, Microsoft secara eksplisit menyatakan bahwa Copilot memiliki potensi untuk menghasilkan informasi yang salah atau tidak beroperasi sebagaimana mestinya. Oleh karena itu, perusahaan meminta pengguna untuk tidak menjadikan hasil dari AI tersebut sebagai basis utama dalam pengambilan keputusan penting. Risiko penggunaan sepenuhnya dibebankan kepada pundak pengguna. Hal ini menciptakan sebuah paradoks: di satu sisi Microsoft ingin AI dianggap sebagai mitra kerja yang andal (melalui fitur seperti Copilot Cowork), namun di sisi lain mereka secara hukum mencuci tangan dari segala konsekuensi serius yang mungkin timbul.

Dampak Pasar dan Respon Microsoft

Kabar mengenai klausul “hiburan” ini tidak hanya ramai di media sosial, tetapi juga berdampak langsung pada nilai perusahaan. Saham Microsoft dilaporkan mengalami penurunan signifikan hingga 10 persen dalam waktu singkat akibat kekhawatiran investor terhadap kesiapan dan kepercayaan diri perusahaan terhadap teknologinya sendiri.

Menanggapi kegaduhan tersebut, pihak Microsoft memberikan klarifikasi bahwa frasa “untuk tujuan hiburan” sebenarnya adalah warisan bahasa lama (legacy language). Istilah tersebut berasal dari masa awal pengembangan ketika AI mereka masih melekat pada fungsi pendamping mesin pencari Bing. Microsoft berjanji akan segera memperbarui ketentuan tersebut agar lebih mencerminkan kapabilitas dan penggunaan Copilot di masa sekarang yang sudah jauh lebih berkembang.

Pelajaran tentang ‘Automation Bias’ dan Halusinasi AI

Kasus ini sebenarnya mencerminkan fenomena yang lebih luas di industri kecerdasan buatan. Hampir semua perusahaan AI, termasuk pengembang ChatGPT atau Claude, menyertakan disclaimer serupa untuk melindungi diri dari tuntutan hukum. Masalah utama yang mendasarinya adalah “halusinasi AI”—sebuah kondisi di mana model bahasa besar memberikan informasi yang terdengar sangat meyakinkan namun sebenarnya sepenuhnya salah atau tidak akurat.

Para ahli teknologi juga menyoroti bahaya automation bias, yaitu kecenderungan psikologis manusia untuk terlalu percaya pada keputusan atau data yang dihasilkan oleh sistem otomatis. Karena antarmuka Copilot yang canggih dan bahasanya yang persuasif, pengguna sering kali lupa untuk melakukan verifikasi mandiri.

Kesimpulan

Meskipun Copilot menawarkan potensi luar biasa dalam mengubah cara manusia bekerja, peringatan dalam ketentuan penggunaan tersebut tetap menjadi pengingat penting. Teknologi AI generatif saat ini masih berada dalam tahap pengembangan dan belum sempurna. Pengguna diimbau untuk tetap bersikap kritis, skeptis, dan memperlakukan setiap jawaban dari AI sebagai saran mentah yang wajib dikonfirmasi kembali dengan sumber yang valid, terutama jika menyangkut keputusan medis, hukum, atau finansial yang signifikan. Layanan ini mungkin sangat membantu, namun manusia tetaplah pengambil keputusan akhir yang bertanggung jawab.